Модели искусственного интеллекта меняются быстро: лучшая модель для агентного программирования сегодня может через три месяца оказаться совершенно другой моделью от другого поставщика. Кроме того, реальные сценарии использования часто требуют обращения более чем к одной модели. Ваш агент поддержки клиентов может использовать быструю и дешевую модель для классификации сообщения пользователя; большую, способную к рассуждениям модель для планирования действий; и легковесную модель для выполнения отдельных задач.

Это означает, что вам нужен доступ ко всем моделям, без финансовой и операционной привязки к одному поставщику. Также необходимы правильные системы для мониторинга затрат у разных поставщиков, обеспечения надежности при сбое у одного из них и управления задержками, независимо от местоположения ваших пользователей.

Эти проблемы возникают при любой разработке с использованием ИИ, но они становятся еще более острыми, когда вы создаете агентов. Простой чат-бот может делать один инференс-запрос на каждое сообщение пользователя. Агент же может связать десять вызовов для выполнения одной задачи, и тогда один медленный поставщик добавляет не 50 мс, а 500 мс. Один неудачный запрос — это не просто повторная попытка, а внезапная цепь последующих сбоев.

С момента запуска AI Gateway и Workers AI мы увидели невероятное распространение среди разработчиков, создающих приложения на базе ИИ на Cloudflare, и мы быстро выпускаем обновления, чтобы успевать! Только за последние несколько месяцев мы обновили панель управления, добавили шлюзы по умолчанию без настройки, автоматические повторные попытки при сбоях у поставщиков и более детализированный контроль логирования. Сегодня мы превращаем Cloudflare в унифицированный слой инференса: один API для доступа к любой модели ИИ от любого поставщика, созданный для скорости и надежности.

Один каталог, одна унифицированная конечная точка

Начиная с сегодняшнего дня, вы можете вызывать сторонние модели, используя то же самое связывание AI.run(), которое вы уже применяете для Workers AI. Если вы используете Workers, переход от модели, размещенной на Cloudflare, к модели от OpenAI, Anthropic или любого другого поставщика — это изменение в одну строку.

const response = await env.AI.run('anthropic/claude-opus-4-6',{

input: 'What is Cloudflare?',

}, {

gateway: { id: "default" },

});Для тех, кто не использует Workers, мы выпустим поддержку REST API в ближайшие недели, чтобы вы могли получить доступ ко всему каталогу моделей из любой среды.

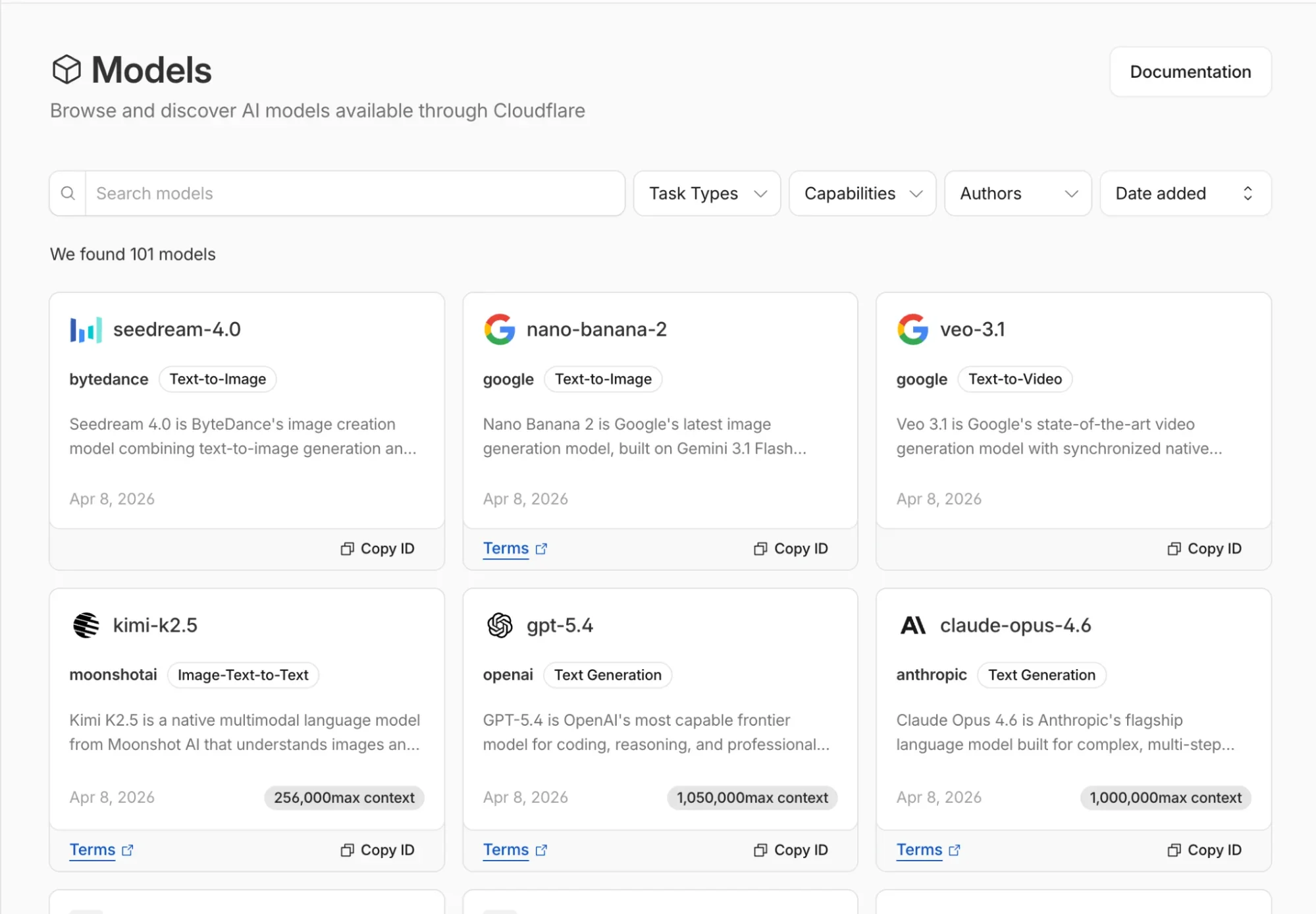

Мы также рады сообщить, что теперь у вас будет доступ к более чем 70 моделям от более чем 12 поставщиков — все через один API, одну строку кода для переключения между ними и один набор кредитов для их оплаты. И мы быстро расширяем этот список.

Вы можете просмотреть наш каталог моделей, чтобы найти лучшую модель для вашего случая использования, от моделей с открытым исходным кодом, размещенных на Cloudflare Workers AI, до проприетарных моделей от основных поставщиков. Мы рады расширить доступ к моделям от Alibaba Cloud, AssemblyAI, Bytedance, Google, InWorld, MiniMax, OpenAI, Pixverse, Recraft, Runway и Vidu — которые будут предоставлять свои модели через AI Gateway. Особенно важно, что мы расширяем наше предложение моделей, включив в него модели для работы с изображениями, видео и речью, чтобы вы могли создавать мультимодальные приложения

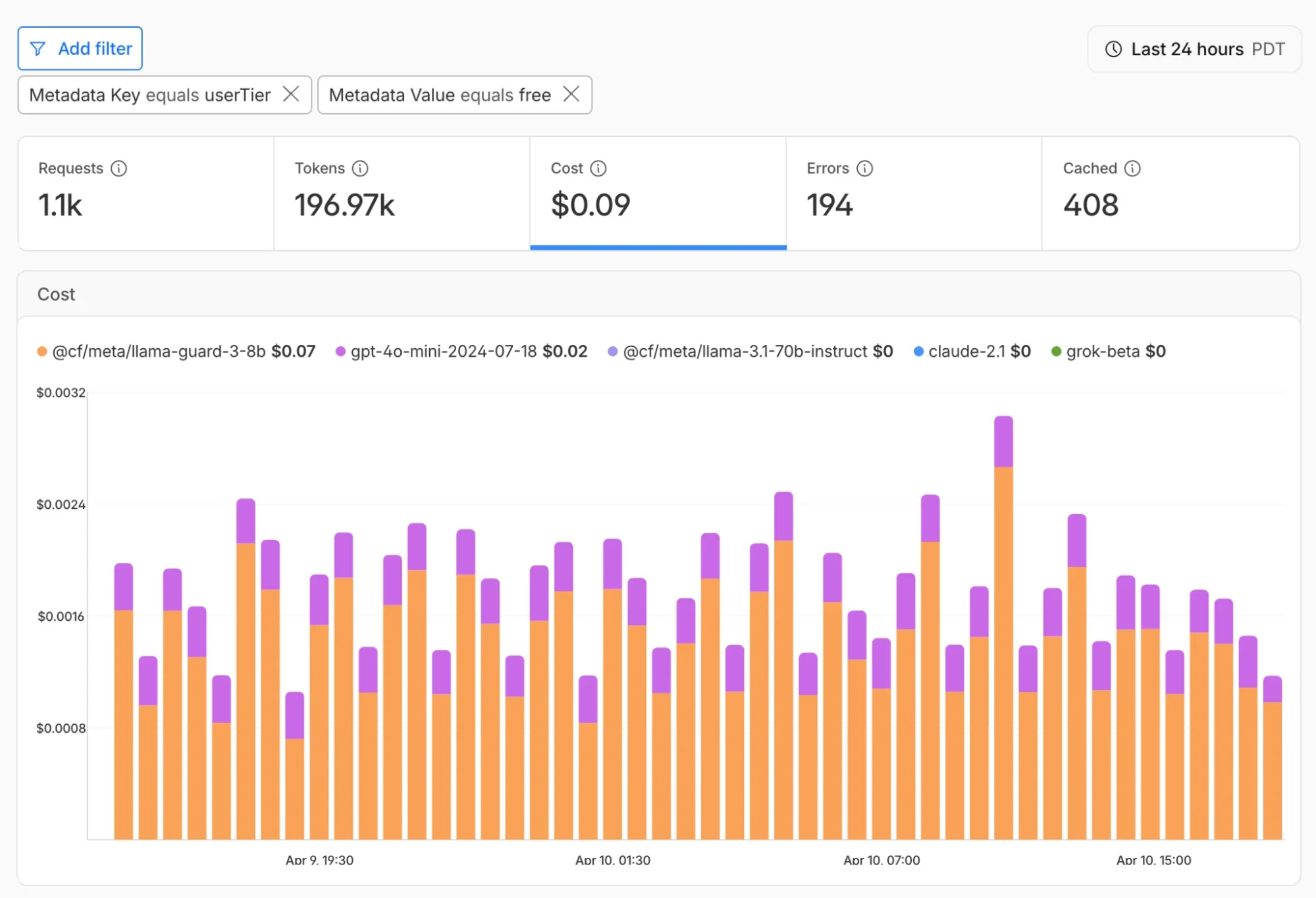

Доступ ко всем вашим моделям через один API также означает, что вы можете управлять всеми вашими расходами на ИИ в одном месте. Большинство компаний сегодня вызывают в среднем 3,5 модели у нескольких поставщиков, что означает, что ни один поставщик не может дать вам целостную картину использования ИИ. С AI Gateway вы получите одно централизованное место для мониторинга и управления расходами на ИИ.

Включая пользовательские метаданные в свои запросы, вы можете получить разбивку ваших затрат по атрибутам, которые наиболее важны для вас, например, затраты на бесплатных и платных пользователей, на отдельных клиентов или на конкретные рабочие процессы в вашем приложении.

const response = await env.AI.run('@cf/moonshotai/kimi-k2.5',

{

prompt: 'What is AI Gateway?'

},

{

metadata: { "teamId": "AI", "userId": 12345 }

}

);

Принеси свою собственную модель

AI Gateway предоставляет доступ к моделям от всех поставщиков через один API. Но иногда вам нужно запустить модель, которую вы дообучили на своих данных, или модель, оптимизированную для вашего конкретного случая использования. Для этого мы работаем над тем, чтобы позволить пользователям приносить свои собственные модели в Workers AI.

Подавляющее большинство нашего трафика приходится на выделенные экземпляры для корпоративных клиентов, которые запускают пользовательские модели на нашей платформе, и мы хотим сделать это доступным для большего числа клиентов. Для этого мы используем технологию Cog от Replicate, чтобы помочь вам контейнеризировать модели машинного обучения.

Cog разработан очень просто: все, что вам нужно сделать, это записать зависимости в файл cog.yaml и ваш код инференса в файл Python. Cog абстрагирует все сложности упаковки ML-моделей, такие как зависимости CUDA, версии Python, загрузка весов и т.д.

Пример файла cog.yaml:

build:

python_version: "3.13"

python_requirements: requirements.txt

predict: "predict.py:Predictor"Пример файла predict.py, который содержит функцию для настройки модели и функцию, которая запускается при получении запроса на инференс (прогноз):

from cog import BasePredictor, Path, Input

import torch

class Predictor(BasePredictor):

def setup(self):

"""Load the model into memory to make running multiple predictions efficient"""

self.net = torch.load("weights.pth")

def predict(self,

image: Path = Input(description="Image to enlarge"),

scale: float = Input(description="Factor to scale image by", default=1.5)

) -> Path:

"""Run a single prediction on the model"""

# ... pre-processing ...

output = self.net(input)

# ... post-processing ...

return outputЗатем вы можете запустить cog build для создания образа контейнера и отправить свой контейнер Cog в Workers AI. Мы развернем и будем обслуживать модель для вас, к которой вы затем получите доступ через ваши обычные API Workers AI.

Мы работаем над крупными проектами, чтобы сделать это доступным для большего числа клиентов, такими как клиентские API и команды wrangler, чтобы вы могли отправлять свои собственные контейнеры, а также ускорять холодный старт с помощью снимков состояния GPU. Мы тестировали это внутри компании с командами Cloudflare и некоторыми внешними клиентами, которые направляют наше видение. Если вы заинтересованы стать партнером по проектированию с нами, пожалуйста, свяжитесь! Скоро любой сможет упаковать свою модель и использовать ее через Workers AI.

Быстрый путь к первому токену

Использование моделей Workers AI с AI Gateway особенно эффективно, если вы создаете живых агентов — где восприятие скорости пользователем зависит от времени до первого токена или от того, как быстро агент начинает отвечать, а не от того, сколько времени занимает полный ответ. Даже если общий инференс занимает 3 секунды, получение первого токена на 50 мс быстрее создает разницу между агентом, который чувствуется шустрым, и тем, который кажется медлительным.

Сеть центров обработки данных Cloudflare в 330 городах по всему миру означает, что AI Gateway расположен близко как к пользователям, так и к конечным точкам инференса, сводя к минимуму сетевую задержку до начала потоковой передачи.

Workers AI также размещает модели с открытым исходным кодом в своем публичном каталоге, который теперь включает большие модели, специально созданные для агентов, включая Kimi K2.5 и модели речи в реальном времени. Когда вы вызываете эти модели, размещенные на Cloudflare, через AI Gateway, не происходит дополнительного перехода через публичный интернет, поскольку ваш код и инференс выполняются в одной глобальной сети, обеспечивая вашим агентам минимально возможную задержку.

Создан для надежности с автоматическим переключением

При создании агентов скорость — не единственный фактор, который важен для пользователей, надежность тоже имеет значение. Каждый шаг в рабочем процессе агента зависит от предыдущих шагов. Надежный инференс критически важен для агентов, потому что сбой одного вызова может повлиять на всю последующую цепочку.

Через AI Gateway, если вы вызываете модель, которая доступна у нескольких поставщиков, и один поставщик выходит из строя, мы автоматически перенаправим запрос к другому доступному поставщику, без необходимости писать собственную логику переключения.

Если вы создаете долго работающих агентов с помощью Agents SDK, ваши потоковые вызовы инференса также устойчивы к разрывам соединения. AI Gateway буферизует потоковые ответы по мере их генерации, независимо от времени жизни вашего агента. Если ваш агент прерван во время инференса, он может переподключиться к AI Gateway и получить ответ, без необходимости делать новый вызов инференса или платить дважды за одни и те же выходные токены. В сочетании со встроенным созданием контрольных точек в Agents SDK конечный пользователь ничего не заметит.

Replicate

Команда Replicate официально присоединилась к нашей команде AI Platform, настолько, что мы даже не считаем себя отдельными командами. Мы усердно работали над интеграциями между Replicate и Cloudflare, включая добавление всех моделей Replicate в AI Gateway и перенос размещённых моделей на инфраструктуру Cloudflare. Скоро вы сможете получить доступ к любимым моделям с Replicate через AI Gateway, а также размещать модели, развёрнутые на Replicate, в Workers AI.

Начните работу

Чтобы начать, ознакомьтесь с нашей документацией по AI Gateway или Workers AI. Узнайте больше о создании агентов на Cloudflare с помощью Agents SDK.